首次提出

2018年5月26日,李彥宏在貴陽大數據博覽會上首次提出AI倫理四原則。他說,AI時代伴隨技術的快速進步、產品的不斷落地,人們切身感受到AI給生活帶來的改變,從而也需要有新的規則、新的價值觀、新的倫理——至少要在這方面進行討論。不僅無人車要能夠認識紅綠燈,所有新的AI產品、技術都要有共同遵循的理念和規則。

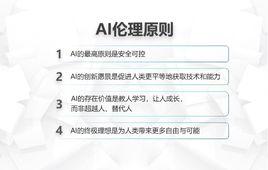

第一, AI的最高原則是安全可控

一輛無人車如果被黑客攻擊了,它有可能變成一個殺人武器,這是絕對不允許的,我們一定要讓它是安全的,是可控的。

第二, AI的創新願景是促進人類更平等地獲取技術和能力

如今,中國的BAT,美國的Facebook、Google,微軟,都擁有很強的AI能力,但是世界上不僅僅只有這幾個大公司需要AI的能力、技術,世界上有幾千萬家公司、組織、機構也很需要AI的技術、能力。我們需要認真思考怎么能夠在新的時代讓所有的企業、所有的人能夠平等地獲取AI的技術和能力,防止在AI時代因為技術的不平等導致人們在生活、工作各個方面變得越來越不平等。

第三, AI存在的價值是教人學習,讓人成長,而非超越人、替代人

AI做出來的很多東西不應該僅僅是去簡單的模仿人,也不是根據人的喜好,你喜歡什麼就給你什麼。我們希望通過AI,通過個性化推薦,教人學習,幫助每一個用戶變成更好的人。

第四, AI的終極理想是為人類帶來更多的自由與可能

我們現在一周工作五天,休息兩天,未來一周也許工作兩天,休息五天。但是更重要的是,很可能因為人工智慧,勞動不再成為人們謀生的手段,而是變成個人自由意志下的一種需求。你想去創新,你想去做創造,所以你才去工作,這是AI的終極理想——為人類帶來更多自由和可能。

AI公司標準中的維度之一

2018年9月17日,上海人工智慧大會上,李彥宏再次提到了AI倫理,他說,一家真正的“AI公司”,不僅技術層面與AI緊密結合,它的文化也必須是“AI化”的。這意味著公司的發展必須遵循AI倫理的四個原則,是因為AI的目標是為了讓世界變得更加美好,是為了把人類從既有的認知局限中解放出來;另外一方面,數據的廣泛可連線和套用,隱私方面的問題會日益凸顯,因此企業必須要牢記初衷,把安全、倫理以及廣泛的社會關懷,融入到公司的血液當中。