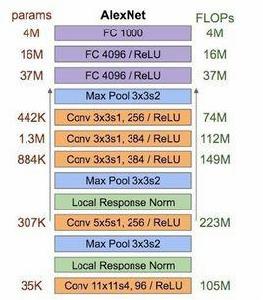

模型簡介

AlexNet中包含了幾個比較新的技術點,也首次在CNN中成功套用了ReLU、Dropout和LRN等Trick。同時AlexNet也使用了GPU進行運算加速。

AlexNet將LeNet的思想發揚光大,把CNN的基本原理套用到了很深很寬的網路中。AlexNet主要使用到的新技術點如下:

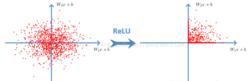

(1)成功使用ReLU作為CNN的激活函式,並驗證其效果在較深的網路超過了Sigmoid,成功解決了Sigmoid在網路較深時的梯度彌散問題。雖然ReLU激活函式在很久之前就被提出了,但是直到AlexNet的出現才將其發揚光大。

(2)訓練時使用Dropout隨機忽略一部分神經元,以避免模型過擬合。Dropout雖有單獨的論文論述,但是AlexNet將其實用化,通過實踐證實了它的效果。在AlexNet中主要是最後幾個全連線層使用了Dropout。

(3)在CNN中使用重疊的最大池化。此前CNN中普遍使用平均池化,AlexNet全部使用最大池化,避免平均池化的模糊化效果。並且AlexNet中提出讓步長比池化核的尺寸小,這樣池化層的輸出之間會有重疊和覆蓋,提升了特徵的豐富性。

(4)提出了LRN層,對局部神經元的活動創建競爭機制,使得其中回響比較大的值變得相對更大,並抑制其他反饋較小的神經元,增強了模型的泛化能力。

(5)使用CUDA加速深度卷積網路的訓練,利用GPU強大的並行計算能力,處理神經網路訓練時大量的矩陣運算。AlexNet使用了兩塊GTX 580 GPU進行訓練,單個GTX 580隻有3GB顯存,這限制了可訓練的網路的最大規模。因此作者將AlexNet分布在兩個GPU上,在每個GPU的顯存中儲存一半的神經元的參數。因為GPU之間通信方便,可以互相訪問顯存,而不需要通過主機記憶體,所以同時使用多塊GPU也是非常高效的。同時,AlexNet的設計讓GPU之間的通信只在網路的某些層進行,控制了通信的性能損耗。

(6)數據增強,隨機地從256*256的原始圖像中截取224*224大小的區域(以及水平翻轉的鏡像),相當於增加了2*(256-224)^2=2048倍的數據量。如果沒有數據增強,僅靠原始的數據量,參數眾多的CNN會陷入過擬合中,使用了數據增強後可以大大減輕過擬合,提升泛化能力。進行預測時,則是取圖片的四個角加中間共5個位置,並進行左右翻轉,一共獲得10張圖片,對他們進行預測並對10次結果求均值。同時,AlexNet論文中提到了會對圖像的RGB數據進行PCA處理,並對主成分做一個標準差為0.1的高斯擾動,增加一些噪聲,這個Trick可以讓錯誤率再下降1%。

AlexNet結構圖

AlexNet結構圖 AlexNet特點

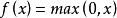

使用了Relu激活函式

AlexNet

AlexNet Relu函式:

圖四

圖四 基於ReLU的深度卷積網路比基於tanh和sigmoid的網路訓練快數倍。

標準化

使用ReLU 後,會發現激活函式之後的值沒有了tanh、sigmoid函式那樣有一個值域區間,所以一般在ReLU之後會做一個normalization,LRU就是穩重提出一種方法,在神經科學中有個概念叫“Lateral inhibition”,講的是活躍的神經元對它周邊神經元的影響。

Dropout

Dropout也是經常說的一個概念,能夠比較有效地防止神經網路的過擬合。 相對於一般如線性模型使用正則的方法來防止模型過擬合,而在神經網路中Dropout通過修改神經網路本身結構來實現。對於某一層神經元,通過定義的機率來隨機刪除一些神經元,同時保持輸入層與輸出層神經元的個人不變,然後按照神經網路的學習方法進行參數更新,下一次疊代中,重新隨機刪除一些神經元,直至訓練結束。