兩大瓶頸

兩大瓶頸主要體現在2個方面:吞吐量與IOPS。

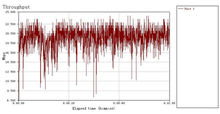

吞吐量

IOPS

IOPS吞吐量主要取決於陣列的構架,光纖通道的大小(陣列一般

都是光纖陣列,至於SCSI這樣的SSA陣列,我們不討論)以及硬碟的個數。陣列的構架與每個陣列不同而不同,他們也都存在內部頻寬(類似於pc的系統匯流排),不過一般情況下,內部頻寬都設計的很充足,不是瓶頸的所在。

光纖通道的影響還是比較大的,如數據倉庫環境中,對數據的流量要求很大,而一塊2Gb的光纖卡,所能支撐的最大流量應當是2Gb/10(小B)=200MB/s(大B)的實際流量,當5塊光纖卡才能達到1GB/s的實際流量,所以數據倉庫環境可以考慮換4Gb的光纖卡。

最後說一下硬碟的限制,這裡是最重要的,當前面的瓶頸不再存在的時候,就要看硬碟的個數了,我下面列一下不同的硬碟所能支撐的流量大小:

10 K rpm 15 K rpm ATA

——— ——— ———

10M/s 13M/s 8M/s

那么,假定一個陣列有120塊15K rpm的光纖硬碟,那么硬碟上最大的可以支撐的流量為120*13=1560MB/s,如果是2Gb的光纖卡,可能需要6塊才能夠,而4Gb的光纖卡,3-4塊就夠了。

IOPS

決定IOPS的主要取決於陣列的算法,cache命中率,以及磁碟個數。陣列的算法因為不同的陣列不同而不同,如我們遇到在hds usp上面,可能因為ldev(lun)存在佇列或者資源限制,而單個ldev的iops就上不去,所以,在使用這個存儲之前,有必要了解這個存儲的一些算法規則與限制。

cache的命中率取決於數據的分布,cache size的大小,數據訪問的規則,以及cache的算法,如果完整的討論下來,這裡將變得很複雜,可以有一天好討論了。我這裡只強調一個cache的命中率,如果一個陣列,讀cache的命中率越高越好,一般表示它可以支持更多的IOPS,為什麼這么說呢?這個就與我們下面要討論的硬碟IOPS有關係了。

硬碟的限制,每個物理硬碟能處理的IOPS是有限制的,如

10 K rpm 15 K rpm ATA

——— ——— ———

100 150 50

同樣,如果一個陣列有120塊15K rpm的光纖硬碟,那么,它能撐的最大IOPS為120*150=18000,這個為硬體限制的理論值,如果超過這個值,硬碟的回響可能會變的非常緩慢而不能正常提供業務。

在raid5與raid10上,讀iops沒有差別,但是,相同的業務寫iops,最終落在磁碟上的iops是有差別的,而我們評估的卻正是磁碟的IOPS,如果達到了磁碟的限制,性能肯定是上不去了。

那我們假定一個case,業務的iops是10000,讀cache命中率是30%,讀iops為60%,寫iops為40%,磁碟個數為120,那么分別計算在raid5與raid10的情況下,每個磁碟的iops為多少。

raid5:

單塊盤的iops = (10000*(1-0.3)*0.6 + 4 * (10000*0.4))/120

= (4200 + 16000)/120

= 168

這裡的10000*(1-0.3)*0.6表示是讀的iops,比例是0.6,除掉cache命中,實際只有4200個iops

而4 * (10000*0.4) 表示寫的iops,因為每一個寫,在raid5中,實際發生了4個io,所以寫的iops為16000個

為了考慮raid5在寫操作的時候,那2個讀操作也可能發生命中,所以更精確的計算為:

單塊盤的iops = (10000*(1-0.3)*0.6 + 2 * (10000*0.4)*(1-0.3) + 2 * (10000*0.4))/120

= (4200 + 5600 + 8000)/120

= 148

計算出來單個盤的iops為148個,基本達到磁碟極限

raid10

單塊盤的iops = (10000*(1-0.3)*0.6 + 2 * (10000*0.4))/120

= (4200 + 8000)/120

= 102

可以看到,因為raid10對於一個寫操作,只發生2次io,所以,同樣的壓力,同樣的磁碟,每個盤的iops只有102個,還遠遠低於磁碟的極限iops。

在一個實際的case中,一個恢復壓力很大的standby(這裡主要是寫,而且是小io的寫),採用了raid5的方案,發現性能很差,通過分析,每個磁碟的iops在高峰時期,快達到200了,導致回響速度巨慢無比。後來改造成raid10,就避免了這個性能問題,每個磁碟的iops降到100左右。